1. はじめに

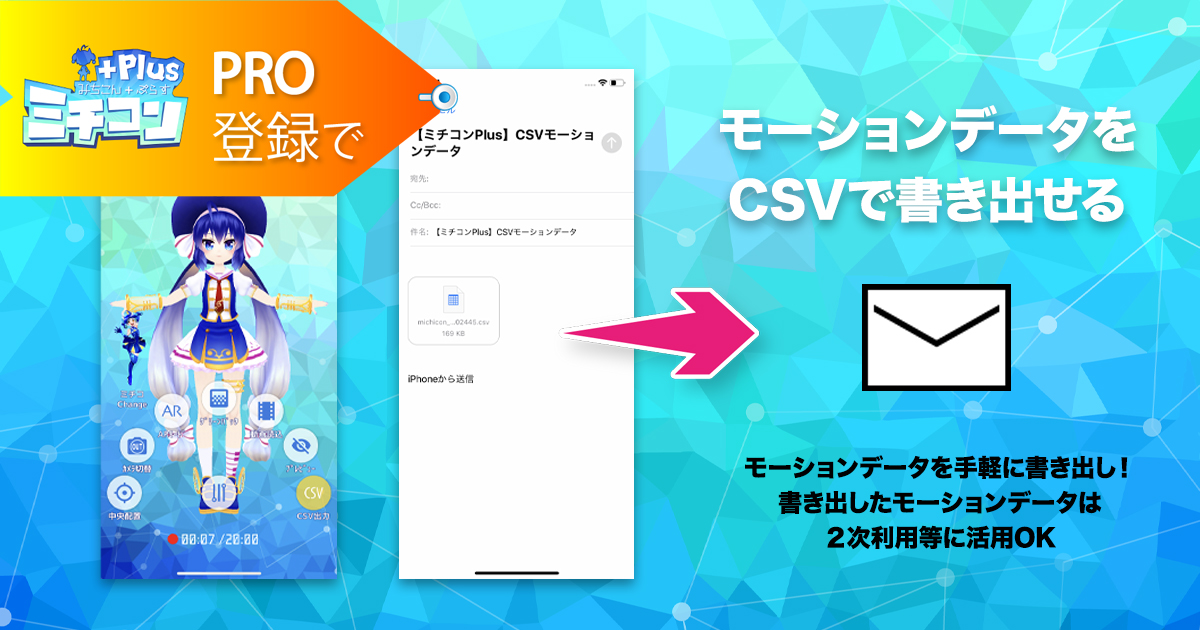

スマホだけでマーカレスの全身トラッキングが可能なミチコンPlusについて、

書き出した.csvをMMDで使える.vmdに変換するまでの手順をまとめてます。

もくじ

ミチコンPlusについてはこちらからご確認ください。

2. 準備

必要なもの

- ミチコンPlusの入ったiPhone

- WindowsPC

- お好きなモデル

- csvAnimationConverter※ ※ csvAnimationConverterありきでの方法を記述してるのであった方が分かりやすいと思います。

その1:Unityのインストール

ダウンロードの場所

こちらからダウンロードして下さい。

インストールの仕方

インストールの手順はUnityインストールと検索するとたくさん出てくると思いますが、公式のものがございましたので一応こちらにリンクを貼っておきます。

Unityのバージョンは?

弊社がGitで公開してるcsvAnimationConverterのプロジェクトは、「2019.1.7」にて開発しています。ご使用の環境にアップグレードしてご利用ください。

※2019.1.7未満のUnityではご使用できません。

その2:csvAnimationConverterのインストール

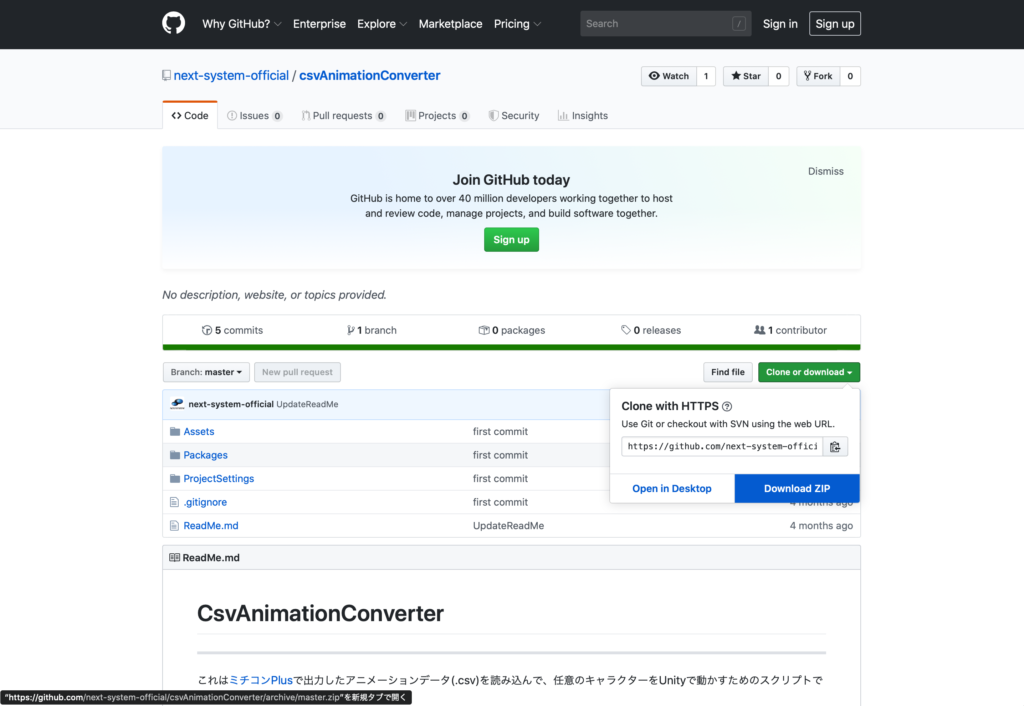

Gitからダウンロード

弊社のGitからcsvAnimationConverterをダウンロードします。

Gitからダウンロードする方法

下の画像を参考にClone or downloadからzipファイルをダウンロードできます。

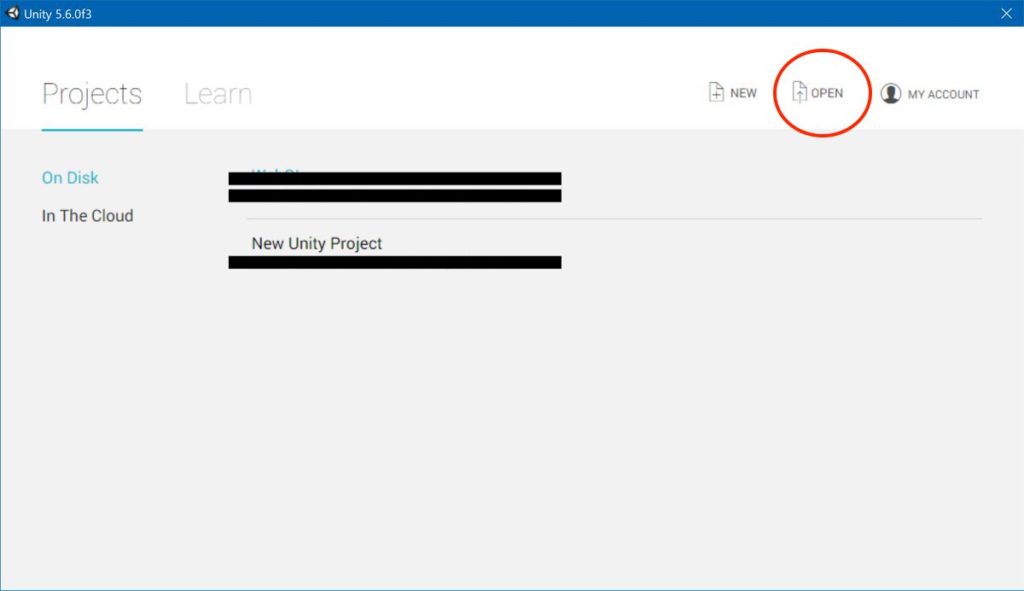

Unityプロジェクトに読み込む

Unityを起動するとプロジェクト選択画面の右上に「OPEN」の文字があるので、そこをクリックします。

先ほど解凍したcsvAnimationConverterを選択したら読み込みが始まります。

3. 手順

その1:【Unity】「 .csv」から「.bvh」への変換

必要なUnityのAssetsは以下になります。

- BVH Toolsを使用します。

利用方法は下記を参照してください。※

※ csvAnimationConverterをダウンロードした方はVBHToolsが既に入ってますので、インポートする必要はありません。

【BVHTools 利用手順】

- UnityAseetsからBVHToolsをインポートして下さい。

- インポートが完了したらHierarchyから「michico」を選択して下さい。

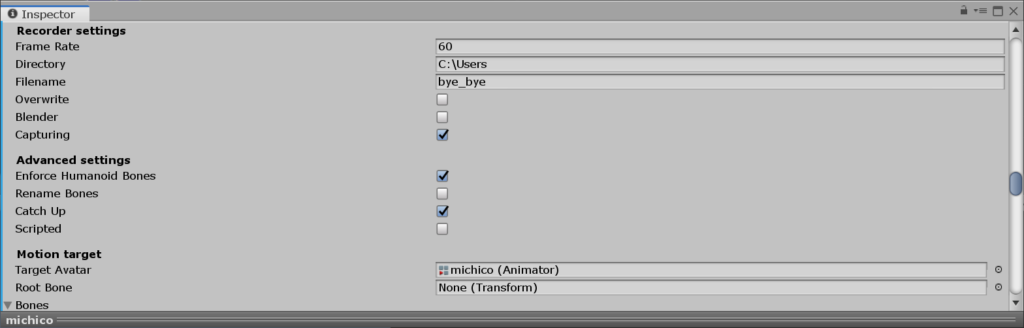

- InspectoreからBVH Recorderを選択し、コンポーネントの値を下記画像を参考に入れて下さい。

- Unity上部の再生ボタンを押しBVHに変換したいアニメーションを再生※します。※csvAnimationコンバーターの再生方法がわからない場合はこちらの動画を参考にして下さい。

- 任意のタイミングでBVH RecorderをアタッチしたオブジェクトのInspectorにあるBVH RecorderコンポーネントのCapturingのチェックを外します。

- その後、BVH Recorderのコンポーネントの下部にあるSave motion to BVH fileボタンをクリックします。これで指定したフォルダーにBVHファイルが出力されます。

その2:【Live Animation】「 .bvh」から「 .vmd 」への変換

必要なソフトウェアは以下になります。

- Live Animaitonを使用します。

利用方法は下記を参照してください。

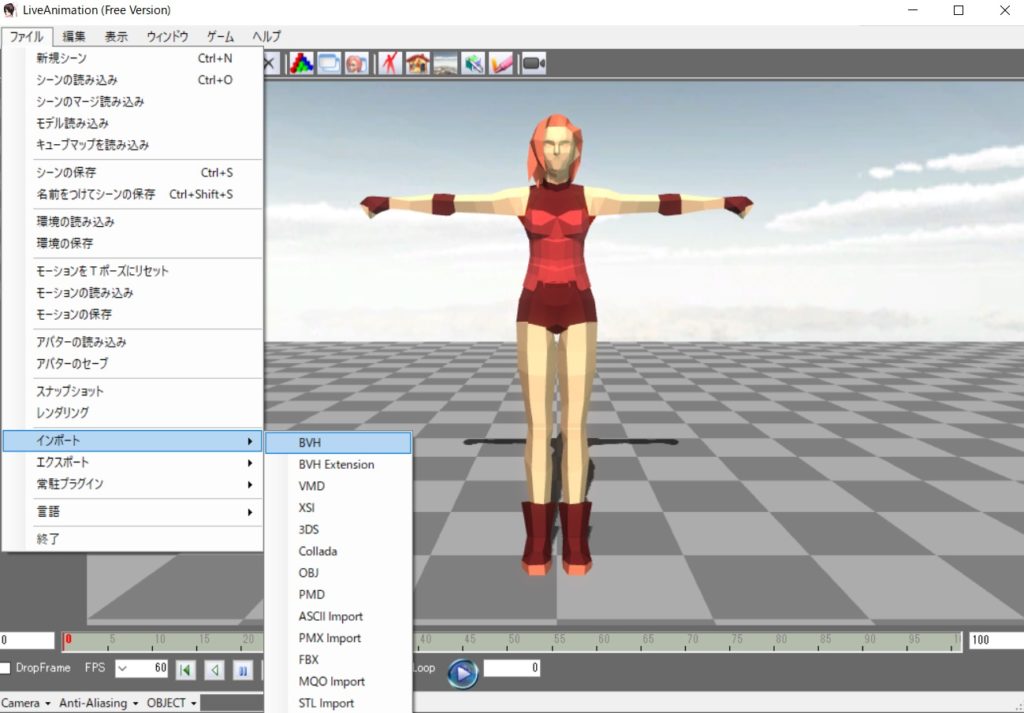

【Live Animation 利用手順】

- 上に記述したリンクより最新のLiveAnimationをダウンロードします。

- zipファイルを解凍し、LiveAnimation.exeをクリックし起動します。

- 起動を確認したらまず、左上のからモデルを選択します。

- モデルの表示を確認できたら上部のファイルから「インポート」を選択した下さい。

- 任意の.bvhデータを選択します。その後すぐにモデルに反映されます。

※ モデルの足首が下の画像のようになってしまった場合は、

「ウィンドウ」から「アニメーションエディター」を選択します。アニメーションエディターのウィンドウが開いたら、「コンストレイン」のタブを選択し、「足を地面に接地」をクリックして下さい。基本設定のウィンドウが開きますが閉じて大丈夫です。 その後、コンストレインタブ内の下部にある、「全てフリーズ」をクリックして下さい。 - ホームに戻り再生ボタンを押し、アニメーションが再生されていることを確認して下さい。

※ LiveAnimationはアニメーションのトリミングも可能です。 - 「ファイル」から「エクスポート」を選択して「VMD」拡張子でエクスポートすれば完了です。

ミチコンPlusの全身モーキャプに使われている技術「VisionPose」とは

ミチコンPlusの全身トラッキングには弊社が独自に開発する姿勢推定AIエンジン「VisionPose(ビジョンポーズ)」が利用されています。(正確にはVisionPose Single3D iOS版)

VisionPoseとは、マーカーレスで人の骨格・姿勢情報が2D/3D解析可能な、姿勢推定(Pose Estimation)AIエンジンです。カメラ映像の他、静止画・動画も利用できます。

また、弊社標準の学習済モデルを搭載し、追加学習(アノテーション)がオプションで可能です。

「ミチコンPlusだけじゃやりたいことができない!」

「この動きをもっと綺麗にとりたい!」

・・・などのご要望がもしありましたら、

もしかしたらVisionPose SDKを利用して新規開発した方が良いかもしれません。

まずはお気軽にご相談ください。

▼VisionPoseについてはこちらから